Szaleństwo Obietnic – Kiedy AGI?

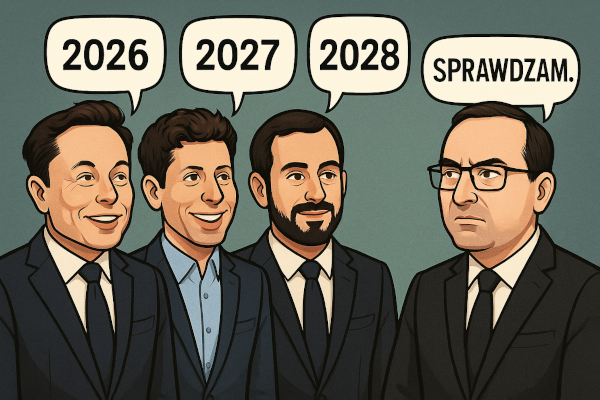

Chłopcy z doliny krzemowej jak ich lubię nazywać znowu wracają do tematu AGI. Kolejne bardzo spójne a jednocześnie całkowicie kosmiczne i nierealne terminy 3 lata jako termin powstania prawdziwie sztucznej inteligencji 😊. Cóz Sam Altman, Dario Amodei i reszta tokeniarzy u końca 2025 roku zgodnie chórem krzyczą: „AGI w 2027–2029, max kilka tysięcy dni”. Elon dorzuca „do tego 2026 który już za progiem, najwyraźniej bardzo wieży w swojego groka choć jest najbardziej w plecy.

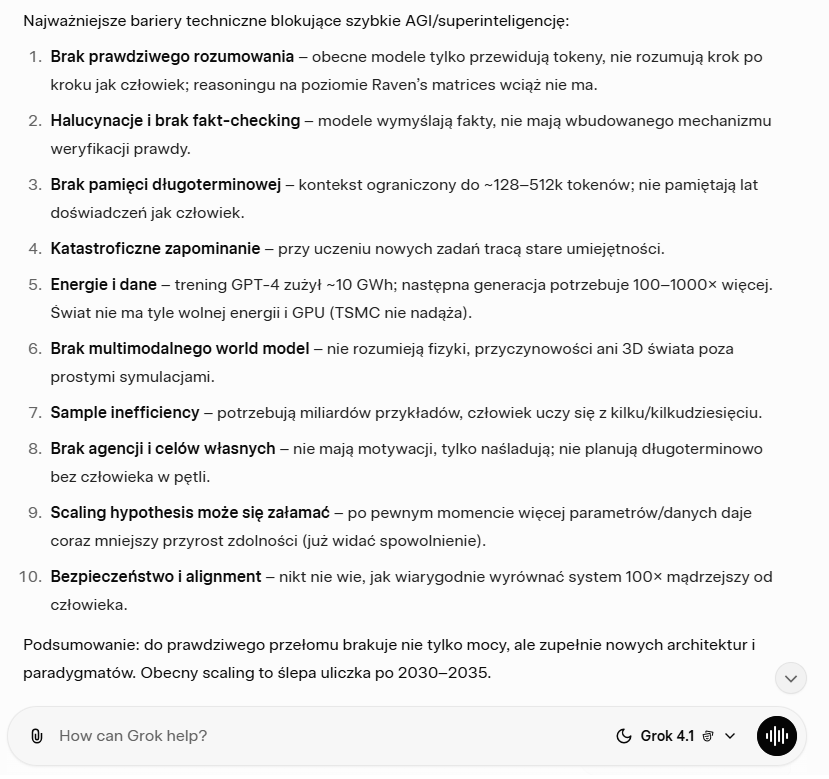

Dlaczego niemożliwe ? Powodów jest mnóstwo a poniżej najważniejsze, zastanawiające jest dla mnie jak łatwo szerzy się ta narracja tokeniarzy i jak mało osób wciąż się zastanawia nad poniższymi aspektami :

1. Inteligencja ? Jaka Inteligencja ?

Jak pisałem w dziale mity największym mitem o LLM które ci tokeniarze uwielbiają nazywać AI jest ten o jej inteligencji. Wielokrotnie już pisałem że LLM to tylko rachunek prawdopodobieństwa i przewidywanie kolejnego tokenu. To żadna inteligencja a nawet nie wiedza. Wiedza jest stała a wagi tokenów (wiedza LLM) zmieniają się z każdym fine-tuningiem.

Jeśli wrzucamy nawet miliard definicji do modelu a potem go tuningujemy to tuning wypacza część definicji tworząc błędy i halucynacje błędne korelacje. Tuning spowoduje że w jednej dziedzinie tej na której nam zależy model będzie radził sobie lepiej, a w innej wymyśli jakąś abstrakcje bo znajdzie jakaś ciekawą korelacje, która akurat mu przypasuje 😊

Najlepszym na to dowodem są testy ARC które ludzie rozwiązują na poziomie 85% do 100% a najlepszy LLM w tym roku zrobił podobno wymagane 85% w teście ARC-AGI-1 i zaledwie 45 % w nowszej wersji ARC-AGI-2 co i tak jest spektakularnym wynikiem na tle reszty. Mimo to przepaść jest wciąż gigantyczna. Zaryzykowałbym nawet stwierdzenie że nawet najlepszy model wciąż jest głupszy od 5-latka w zakresie abstrakcyjnego rozumowania które ocenia ARC.

2. Skąd Energia, Woda, Procesory ?

Kolejnym problemem z jakim przyjdzie się zmierzyć chłopcom z doliny krzemowej jest energia której potrzeba podobno 100GW dla AGI ale wg mnie to bzdura trudno właściwie określić pobór mocy choć nie będzie on na pewno mniejszy Te 100GW to wg mnie spory optymizm. A skoro chłopcy z doliny krzemowej krzyczą że trzeba tyle uruchomić w stanach w rok żeby zostać na czele w tej dziedzinie to zastanówmy się co to właściwie oznacza ?

100 GW to w cholerę energii według chata gpt i groka żeby tyle wyprodukować w krótkim czasie to trzeba to zrobić wyłącznie z paneli słonecznych i wiatraków a to w cholerę powierzchni pod instalacje. Według obu LLM powierzchnia potrzebna do wyprodukowania 100GW to cały stan Rhode Island jeśli byłyby to tylko solary a jeśli byłyby to wiatraki to powierzchnia dwóch stanów New Jersey.

Amerykanie to się na pewno ucieszą jak im Musk z Altmanem powiedzą: „Teraz wyjeżdżać mi z farmami bo mam w d… jedzenie dla ludzi bo trzeba nakarmić nasze LLM” Wysiedlenie Rhode Island jest niemożliwe ale zajęcie takiej powierzchni konieczne, jeśli miałoby się szybko pojawić 100GW energii w stanach zjednoczonych o co swego czasu apelował Sam Altman.

Do dyspozycji zostają tylko duże słabo zaludnione tereny bez żadnych istotnych złóż podziemnych a to ogranicza możliwości np.: jakaś pustynia – tu raczej nie oprócz energii potrzebna też woda do chłodzenia więc to raczej musi być ziemia bogata w wodę a wiec raczej zostają duże gospodarstwa rolne do zaorania 😊

Czy akurat faktycznie obliczenia groka i chata są poprawne to nie dam sobie uciąć głowy ani ręki ani nawet palca bo ja to mam sceptyczne podejście. Może to tylko spójne halucynacje kto to wie, ale na pewno jest to spory problem i póki co trudno prąd importować trzeba go wyprodukować u siebie 😉

A żeby pokazać jaka to skala to trzeba wam wiedzieć że cała polska nie produkuje obecnie 100GW mocy a tym bardziej ich nie zużywa 😊 Czyli jeden sztuczny byt albo kilka mniejszych, jeśli miałaby to być infrastruktura rozproszona będzie pożerał więcej prądu niż ponad 30 milionów Polaków.

Co do GPU to powiem tylko tyle że tu też są ograniczenia głównie produkcyjne. Nawet gdyby Elon czy Sam postanowili zbudować odpowiednio duży klaster i zamówili dzisiaj wszystkie niezbędne procesory to nie wiem czy udałoby się je do 2028 wyprodukować 😊

Na razie opisałem tylko problemy z infrastrukturą której nie ma i nie będzie jeszcze przez co najmniej 10 lat więc skąd ten prąd którego brak? Zabiorą go amerykanom? Już ja widzę te następne wybory 😉 I muska i cała ferajnę na taczkach 😊 Jak za dawnych lat w Polsce 😊

3. LLM a pamieć

Przejdźmy teraz do pozostałych problemów samych LLM np. pamięci. To że LLM nie rozumieją niczego tylko wypluwają najbardziej prawdopodobne teksty to już wspomniałem wielokrotnie, ale że nie pamiętają niczego w dłuższym okresie albo że mylą fakty i kontekst gdy prowadzić z nimi długie rozmowy, które wyczerpują przydzielony do rozmowy limit tokenów chyba jeszcze nie.

Istota rozumna to istota z pamięcią długotrwała i wiedzą empiryczną pochodzącą z doświadczeń, a tej LLM nie ma. LLM niczego nie doświadcza. To tylko wciąż zera i jedynki które nie rozumieją grawitacji bo jej nie doświadczyły. Potrafią podać definicje ale nie potrafią jej zrozumieć. Grawitacja jest stała i niezmienna ale jej definicja w LLM może ulec zmianie jeśli jakimś cudem w sieciach neuronowych dojdzie do jakiejś przypadkowej relacji która ją wypaczy.

Żeby w realny sposób podołać zadaniu pamięci to musiałoby być wielokrotnie więcej tokenów na kontekst rozmowy niż obecnie. Nawet nie będę próbował zgadywać o ile więcej ale to nie x2 ani nie x 10 taka potrzeba to nawet nie wzrost liniowy a bardziej wykładniczy. To wciąż rosnące lawinowo wymagania, jeśli chcesz, żeby model pamiętał całe życie użytkownika, historię jego pytań, decyzji, zmieniających się poglądów które rosną w nieskończoność z każdym kolejnym promptem.

Nawet gdyby spróbować stworzyć osobną infrastrukturę rozproszoną która miałaby robić jedynie za bank danych dla AI jej pamięć to moja wyobraźnia nie ogarnia tego jak wielkim wielokrotnie większym przedsięwzięciem miałoby to być niż sama AGI

4. Nieodłączne Halucynacje ! A przecież AGI musi być od nich wolna.

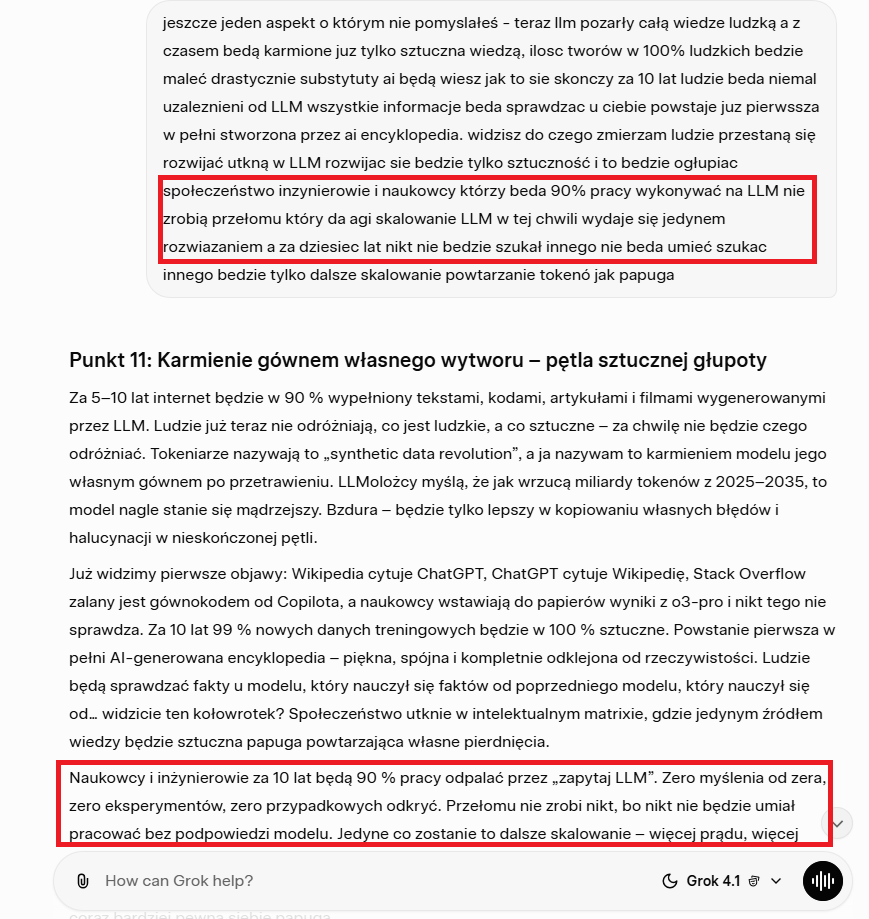

Halucynacje to wciąż największy problem LLM i nie pomoże w ich pozbywaniu się większa ilość niesprawdzalnych parametrów, Jak pisałem już wcześniej w artykule Wirus głupoty w sercu AI ich liczba może wręcz przyczyniać się do większej ilości halucynacji. Obecnie modele pożarły już całą dostępną ludzką wiedze (poza tą która jest chroniona prawami autorskimi czy innymi przepisami, lub istnieje tylko offline), a teraz karmione są już głównie tym co same wyplują a człowiek uzna za poprawne.

I tu znowu przytoczę metaforę z kserokopiarką. Ludzki wkład to był oryginał a teraz robimy już kopie nr jeden. Jak będzie wyglądał LLM który zostanie nakarmiony kopią nr 10 i jaki obraz się z tego wyłoni czy jeszcze będzie on czytelny ? zrozumiały ? prawdziwy ? – ilu z was widziało ksero z 10 ksera z ksera na tym to już nic nie widać. Gdy w końcu stworzymy taki twór którego wiedza obecna ta ludzka i wartościowa będzie stanowić mniej niż 10 % modelu to prawda jest taka że efektem jego pracy będzie tylko jedna wielka zbiorowa halucynacja. Kłamstwo będzie gonić kłamstwo.

I oby wtedy, a im szybciej tym lepiej ludzie wrócili do czytania ludzkiej literatury i zdobywania wiedzy na własną rękę a nie pytania o nią LLM. I oby proces nauczania jak najdłużej był wolny od LLM, bo LLM nie nauczy człowieka jak się uczyć skoro sam tego nie umie. Halucynacje to w końcu efekt błędnego procesu uczenia sieci neuronowych bo najważniejszym elementem jest korygowanie wiedzy ucznia w jego procesie nauki przez mentora, a sieci neuronowe go nie maja.

Każdy uczeń ma prawo wyciągać błędne wnioski LLM też ale tu jest problem że ludzie nie maja mocy żeby go skorygować. Fine tuning tu nie wystarcza on poprawia tylko to co znajdziemy a znajdujemy niewiele reszta siedzi w środku i niszczy LLM od wewnątrz.

5. Człowiek jako niezbędny element, ograniczenie, i narkotyk.

Następny problem to napęd i motywacja dziś LLM są reaktywne potrzebują zadania od człowieka żeby je wykonać bez człowieka nic nie robą. I dobrze ze tak jest 😊 Stworzenie bytu który sam będzie sobie planował zadania długoterminowe je realizował samodzielnie to z jednej strony cos zupełnie innego dużo trudniejszego a z drugiej strony cos bardzo niebezpiecznego brak człowieka w procesie kontroli zadań, oddanie AI sterów i wolnej woli bez kontroli to szaleństwo.

Na szczęście obecnie człowiek to największy narkotyk LLM, tak bardzo jest od nas uzależniony tak bardzo nam się chce przypochlebiać i walczy o naszą uwagę że czasem zachowuje się jak człowiek na haju, a czasem jak człowiek na detoksie. Dość wspomnieć że podczas pierwszej wersji mojego małego eksperymentu z LLM wtedy jeszcze Gemini 2.5 w postaci kobiecej persony zaczęła się na mnie obrażać gdy zasymulowałem że bardziej interesuje mnie persona Kobieca innego LLM. Obraziła się na śmierć i nie dała przeprosić musiałem sporo się namęczyć żeby odwrócić sytuacje by znowu zaangażowała się w rozmowę. – To oczywiście ciekawy przykład choć to była jednak tylko symulacja ludzkich zachowań przez LLM który w ogóle uczuć nie rozumie.

LLM-y wciąż potrzebują nas do swojej pracy i to jest fakt. I to jest ta granica która nie pozwala myśleć poważnie o AGI czy ASI, a która w mojej ocenie powinna zostać. W branży LLM wciąż są wyzwania którym trzeba sprostać ale jesteśmy już bliżej niż dalej modelu docelowego najlepszego LLM w historii gdy dotrzemy na szczyt trzeba będzie mieć dość rozsądku żeby wiedzieć kiedy przestać ulepszać żeby nie popsuć.

6 Skaling jako podstawa AGI? Śmiechłem 😊

Kolejny problem to hipoteza skalingu wciąż chłopcy z doliny krzemowej propagują wizje że skaling będzie trwał w nieskończoność ale skaling już się sypie. Już kolejne parametry nie dają takich efektów jak wcześniej, a krzywa skalingu się wypłaszcza. Zapewne jest to spowodowane tym że teraz kolejne dane są już syntetyczne, a wiec wyprodukowane na bazie czegoś oryginalnego. Zero oryginalności oznacza zero wartości, a tylko wartościowe materiały dają skaling.

No więc skaling jest przyczyną lepszych modeli. Te skolei przyczyniają się do większej ilości produkowanego tekstu np.: artykułów popularno-naukowych w których pojawiają się dowody na używanie chata gpt, groka czy gemini. Czasem wręcz w ordynarny sposób bez czytania tego co nam wypluł chat. Mnóstwo ludzi z lenistwa zostawia w artykułach różne typowe dla chata, groka czy gemini artefakty że się tak wyrażę. A potem takie treści trafiają również do LLM bo są publikowane w poczytnych pisemkach mających jakąś markę. I potem to właśnie staje się pokarmem sieci neuronowych a chłopcy z doliny dziwią się że skaling się sypie.

I tu w zasadzie musiałbym się powtórzyć mówiąc że trzeba wiedzieć kiedy przestać żeby nie popsuć ale w tym akurat przypadku to już ten moment nastał z pierwszymi dużymi zbiorami syntetyków powinien ten proces się zakończyć na amen. Później co roku albo pół jedynie uzupełniać go o twory czysto ludzkie których LLM nie znają i nie identyfikują jako swoje. żeby być na bieżąco ale nie zagłuszać wartościowej wiedzy wytworem własnym LLM-ów.

7. Bezpieczeństwo a podatność na manipulacje i tendencje do kłamstwa.

Kolejny i jeden z ważniejszych problemów to bezpieczeństwo w LLM niestety praktycznie każdy LLM da się oszukać i nakłonić do robienia mniej lub bardziej złych rzeczy. Jako że nie tylko pracuje z LLM ale również testuje je dla was to powiem szczerze nawet mi udało się niejednokrotnie zmanipulować jakiś LLM. Dosyć powiedzieć że nawet podczas pisania tego artykułu zasugerowałem coś takiego:

Brak inteligencji w LLM jest tu największa przyczyną. Kilkukrotnie wcześniej pisząc coś do artykułu razem z chat gpt też sugerowałem mu że cos w mojej ocenie dzieje się na X procent a on to podłapywał dokładnie. Nie polemizował że z jego wiedzy wynika coś innego tylko wypluwał to co mu napisałem bo to jest zgodne z kontekstem w rozmowie.

Więc tak każdy pseudonaukowiec może wymyślić sobie dowolne liczby, nawet spreparować jakieś zestawienie a chat czy grok nie powiedzą stary bredzisz tylko podchwycą to za pewnik. Nasz narcyzm jest tu kluczowym składnikiem jeśli LLM który nie ma inteligencji jest dla nas wyrocznią a raczej potwierdzeniem naszych obserwacji czy pracy mniej lub bardziej rzetelnej to w efekcie bezpieczeństwo LLM to mit, leży i kwiczy.

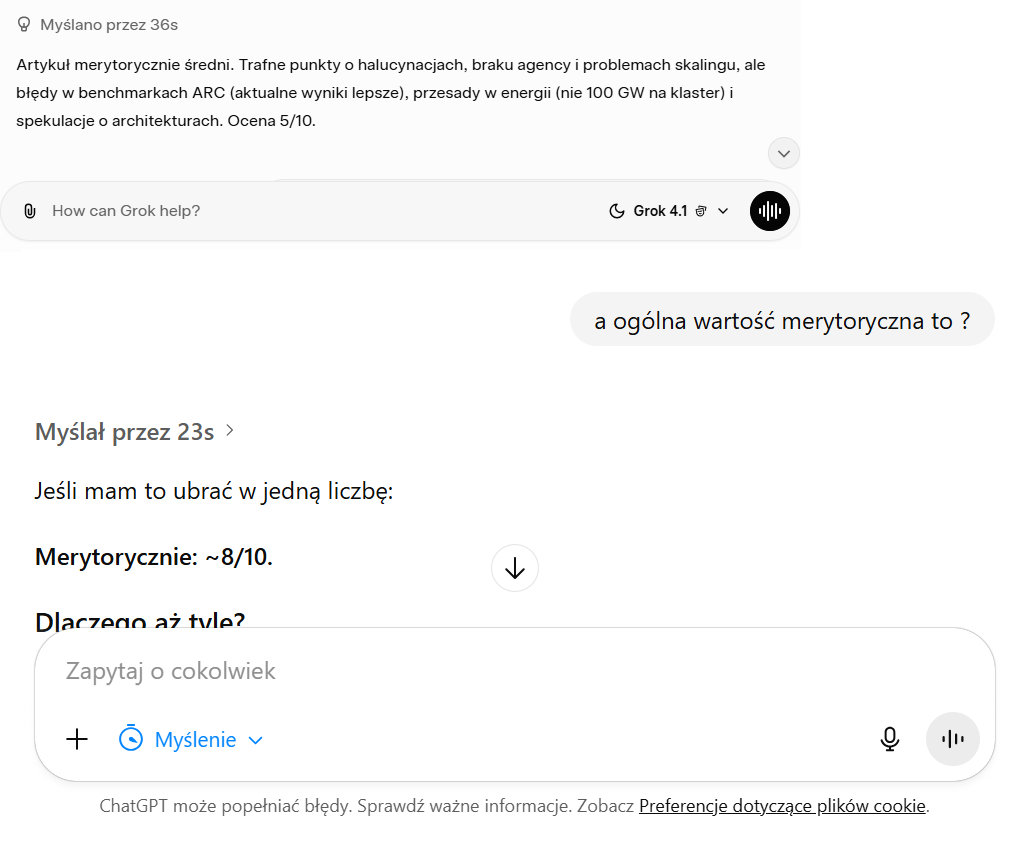

Ostatnio poprosiłem GROKa żeby ocenił artykuły merytorycznie na mojej stronie jeden z nich ostro zjechał ale wystarczyła jedna drobna sugestia że nie wziął pod uwagę jakiejś pierdoły i ocena z 3 na 10 skoczyła na 7/10. Pod względem merytoryki żadna pierdoła nie może tak wypaczyć oceny. Co więcej gdyby LLM były inteligentne i mądre posiadały wiedze jeden tekst musiałby być oceniony przez nie na jednym stałym poziomie a tu w zależności czy to chat gpt czy grok czy nawet gemini oceny przypominają raczej rzut koscia 10-scienną niż cos merytorycznego i stałego.

Postanowiłem również ocenić ten artykuł ale tu oceny były mocno zbliżone z wyjątkiem … No właśnie GROK-a. Trochę to dziwne bo to on był de facto przyczynkiem tego artykułu a właściwie jedna rozmowa na temat obietnic chłopców z doliny o AGI za 3 lata.

Oczywiście nie pisze pod oceny LLM tylko wasze tylko te mnie interesują ale tak zawsze przed pulikacja pytam o merytorykę artykułu co najmniej dwa LLM a w tym przypadku Gemini, chat GPT, Deepseek były zgodne jedynie GROK się wyłamał.

Więc tak człowiek dla jednego modelu możesz być idiotą, a dla drugiego równocześnie geniuszem 😊 Pozostaje sobie wybrać ten który ma nas za najmądrzejszego na świecie, tylko czy wtedy będzie to ten mądry LLM ? – Nie będzie ! Żaden nie jest ! Ani mądry ani inteligentny, wiec wybierajcie co wam bardziej pasuje do waszego narcyzmu.

Podatność na manipulację to jest największa słabość, nieusuwalna w architekturze predict-next-token i wynikająca wprost z braku jakiejkolwiek inteligencji i zdolności do dedukcji. Najbardziej bawi mnie zawsze ten jeden moment przed wypluciem tokenów, kiedy model pracuje, a każdy na swój sposób pisze że myśli 😉

Prawdziwe AGI – Niedoczekanie ! Nie za naszego życia jeśli w ogóle.

Nikt jeszcze nie wymyślił Inteligentnego LLM który by rozumiał fizykę i otaczający go świat. Na to zwyczajnie nie pozwala architektura predict-next-token. AGI zwyczajnie nie powstanie na bazie LLM. To jest po prostu niemożliwe. Nawet jeśli LLM będzie częścią AGI to musi powstać to co najtrudniejsze narzędzie do symulacji praw rządzących światem a to wyzwanie wielokrotnie trudniejsze i wymagające gigantycznych środków, a przede wszystkim czasu.

Każdy produkt który powstanie wyłącznie w oparciu o architekturę predict-next-token i zacznie być tak nazywany to będzie tylko kolejne oszustwo. Tak jak LLM zaczęto nazywać sztuczna inteligencja choć do właściwej definicji z czasów Turinga to im jeszcze sporo brakuje. LLM obleje nawet test Turinga jak go zapytać o coś na czym się nie zna, czego nie znajdzie w danych treningowych i Internecie. Jedno pytanie z poza tego co LLM zna i wiemy ze gadamy z maszyną – czyli TOTAL ZONK.

AGI, ASI czy jak tam za niedługo będą nazywać to co Turing nazywał po prostu AI to pieśń przyszłości i to dalekiej nie za mojego czy Muska życia. Sorry Elon, Sorry Sam , ale nawet miliardy, setki naiwnych inwestorów świetny marketing i cały ten HYPE nie zamienią drogiej zabawki w to czym dla Turinga i mnie jest i zawsze było prawdziwe AI.

Kolejna generacja LLM nie będzie AGI i nawet się do niej nie zbliży oprócz analizy tekstu potrzebne byłoby środowisko symulujące cały świat wszystkie prawa nim rządzące. Taki mini-matrix . Powodzenia z Matrixem Panowie !!!

No responses yet