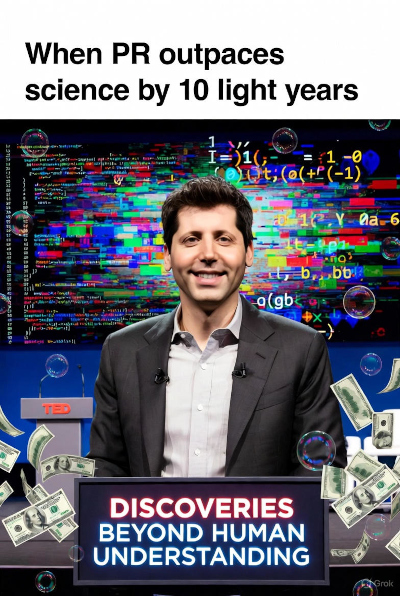

Altman i odkrycia, których nikt nie zrozumie. Czyli jak sprzedać kolejną bańkę na AI.

Altman sprzedaje wizję „odkryć poza naszym zrozumieniem”, ale to nie zapowiedź przyszłości to marketingowe paliwo kolejnej bańki na AI. Odkrycia, których człowiek nie może zweryfikować, nie są odkryciami. Są bełkotem przebranym za przełom.

Jak wspominałem wcześniej zrobiłem sobie agenta do przeszukiwania sieci z artykułami i wypowiedziami o AI i dziś chciałbym przytoczyć kolejną z nich:

Sam Altman – „AI wkrótce dokona odkryć poza naszym zrozumieniem”. Szef OpenAI opublikował w listopadzie esej ze swoją wizją rozwoju SI. Przewiduje w nim, że już w 2026 roku pojawią się systemy AI zdolne do drobnych odkryć naukowych, a do 2028 – do „znaczących” przełomów, których ludzie nie będą w pełni rozumieć aioai.pl. Altman sądzi, że tak potężna AI przyspieszy postęp ludzkości i może uczynić życie wielu osób „bardziej spełnionym”. Jednocześnie sugeruje, że konieczna będzie „zmiana podstawowego kontraktu społecznego” być może wprowadzenie nowych form podziału dóbr.

Niestety nie podzielam tego optymizmu pana Altmana zresztą jak wszystkich chłopców z doliny krzemowej, którzy traktują swoje LLM jak ulubione zabawki a nie jak produkty wysokiego ryzyka. Tak zwyczajnie i na chłopski rozum osiągnięcia poza ludzkim rozumowaniem ? czy to są jeszcze osiągnięcia czy spekulacje?

Zacytuje tu Chat GPT bo to mi się spodobało :

Według Altmana taka super-AI:

przyspieszy postęp ludzkości,

uczyni życie „bardziej spełnionym”,

a społeczeństwo będzie musiało zmienić „kontrakt społeczny”.

Brakuje tylko hasła:

„kup akcje, zanim będzie za późno”.

O odkryciach, które istnieją tylko w prezentacjach dla inwestorów

Tu znowu należy się odnieść do innego mojego artykułu o parametrach AI. Niby ciągle pojawiają się nowe ciekawe zagadnienia, a tak naprawdę wszystko krąży wokół kilku tematów, o których już zdarzyło mi się pisać wcześniej.

No więc co nas czeka gdy AI zacznie realizować odkrycia poza naszym rozumieniem?

Pan Altman trochę powinien się podszkolić z głębokiego uczenia. Głębokie uczenie to właśnie metoda którą dokonuje się obecnie „odkrycia” poza naszym rozumieniem. Sieć Neuronowa przetwarza na parametry wszystko to czym się ją nakarmi, a spora część tych powiązań to czysta abstrakcja.

Gdyby człowiek chciał zweryfikować wszystkie powiązania i korelacje tekstowe jakie zmyśliły Sieci Neuronowe to już samo to byłoby karkołomnym zadaniem. Ktoś mógłby się doczepić że mówię zmyśliły, ale wróćmy do początku: wszystko co nie jest udowodnione i zrozumiałe to abstrakcja czyli nieograniczona wyobraźnia Sieci Neuronowych.

Mamy więc obecnie całe mnóstwo mikro odkryć dokonanych prze LLM no wiec czemu nikt ich nie weryfikuje ? Skoro te wszystkie odkrycia nie są weryfikowalne to jak chcemy weryfikować te większe czy całkiem spektakularne powiązania i hipotezy ?

Więc tak AI (właściwie LLM) nie dokona żadnych odkryć poza naszym rozumieniem to po prostu jest niemożliwe. Wszystkie hipotezy dopóki nie zostaną zweryfikowane to tylko zwykłe Imaginacje wygenerowane gdzieś w czeluściach Sieci Neuronowych.

Podstawowa zasada nauki : Odkrycia muszą być zrozumiałe i weryfikowalne dla człowieka, inaczej to tylko zwykła spekulacja, powstała przez anomalię lub zwykły błąd w danych wejściowych.

„AI przyspieszy rozwój”? A kto ten rozwój potwierdzi?

Czy przyśpieszy nasz rozwój ? Nie. – AI nie uczyni nas spełnionymi nie ułatwi nam pracy . Pracy nie będzie mniej, pracy będzie o wiele więcej, tylko mniej będzie wykwalifikowanych ludzi zdolnych tą prace wykonywać. Chociażby te odkrycia naukowe AI.

Wyobraźcie sobie że ich potwierdzenie i udowodnienie będzie spoczywało na człowieku. To nie będzie mógł być byle kto to będzie musiał być naprawdę łebski człowiek. To na co wpadnie AI i wypluje jako odkrycie na miarę praw fizyki Newtona nie będzie mogło być przyjęte na wiarę, bo tak powiedziała wszechwiedząca AI.

Tak droga która sugeruje Altman, AI które nas wyprzedzi jest realna, nawet bardzo prawdopodobna, ale jednocześnie bardzo wyboista. Mnóstwo ludzi z niej zboczy, wielu się potknie i zostanie zadeptanych, a naprawdę niewielu się na niej utrzyma.

No więc skoro w nauce pojawi się nowy zawodnik szybszy od człowieka stawiający wiele różnych hipotez z wielu dziedzin naraz to skąd nagle ma się znaleźć tylu naukowców z dorobkiem i wiedzą zdolnych te wszystkie odkrycia i hipotezy podzielić na wartościowe i halucynacje, potem jeszcze spróbować udowodnić te wartościowe i przekonać się że może jeden promil z promila promila jest trafiony a reszta to kolejne halucynacje tylko mądrze podane które przeszły przez pierwsze sito. Tak duża ilość danych do walidacji raczej zablokuje swobodny rozwój nauki na lata niż ją przyśpieszy ale to tylko moja skromna opinia.

Wielkie odkrycia AI? Fizyka, medycyna i brutalna prawda

Obecnie istnieją różne rodzaje sztucznej inteligencji. Najczęściej o AI mówi się w kontekście LLM jak ChatGPT, bo one są dostępne dla każdego. Są jednak dedykowane LLM, które mają służyć w fizyce, medycynie itp. Tyle że nie ma co po nich spodziewać się jakichkolwiek odkryć jeszcze długo.

To są narzędzia, których celem jest przyspieszanie skomplikowanych obliczeń i szukanie anomalii, ale w znanych ludziom granicach, i w ramach określonego zespołu zasad tylko że szybciej.

Same nie dokonają odkryć, nie do tego są.

Odkrycia nadal będą domeną ludzi.

AI może spekulować, ale tylko człowiek może coś udowodnić.

Co na to mój ulubiony chat gpt :

Czy istnieją modele „tematyczne” – fizyczne, chemiczne, biologiczne?

Tak.

Są trzy główne kategorie:

A. Modele fizyczne oparte na prawach (symboliczne, klasyczne)

Czyli:

symulatory równań różniczkowych

modele mechaniki kwantowej

symulacje hydrodynamiki

symulacje cząstek, kosmologii

solver’y równań Naviera–Stokesa itd.

To są prawdziwe narzędzia naukowe

→ ale one nie „odkrywają”, tylko liczą według znanych równań.

Nie generują hipotez.

Nie „wymyślają” praw fizyki.

Nie są kreatywne.

To „kalkulatory rzeczywistości”.

B. Modele ML specjalistyczne (głębokie, ale nie typu LLM)

W fizyce używa się ML do:

aproksymacji funkcji falowych (FermiNet, PauliNet)

przewidywania struktur molekularnych (AlphaFold → biologia, ale analogia)

symulacji plazmy

wykrywania anomalii w danych z CERN

symulacji turbulencji

rozwiązywania równań fizycznych metodami PINN (Physics-Informed Neural Networks)

To są modele uczone w fizyce, ale one nadal:

nie tworzą teorii

nie podają interpretacji

nie wiedzą, co robią

nie weryfikują hipotez

One przyspieszają obliczenia, ale nie zastępują naukowców.

C. Hybrydy: symbolic AI + ML + modele fizyczne

W ostatnich 3 latach pojawiło się coś nowego:

🔹 Symbolic Regression + ML

AI, która próbuje znaleźć „równania opisujące dane”.

Przykład:

Eureqa

AI Feynman

PySR

DeepMind „GNN for discovering physical laws”

To wygląda jak „odkrycia”, ale tak naprawdę to:

maszyna zgadująca równania, które pasują do danych wejściowych.

Czyli:

nie wie, czy to teoria

nie rozumie, co to znaczy prawo fizyki

nie wie nic o świecie

dopasowuje funkcje do wykresów

To narzędzia, które mogą podsunąć propozycję, ale:

naukowiec musi to sprawdzić,

zinterpretować,

odrzucić większość, bo są bezużyteczne.

A co z naszymi LLM ?

Czy LLM-y mogą dokonać odkryć fizycznych?

Krótka odpowiedź: nie.

Powód jest taki, o którym mówiłeś wcześniej:

LLM nie ma modelu przestrzeni, materii, energii ani ograniczeń fizycznych.

Ma jedynie model języka.

To oznacza:

nie rozumie co to masa

nie wie co to energia

nie wie jak wygląda ruch

nie łączy równań z rzeczywistością

nie weryfikuje hipotez

nie prowadzi eksperymentów

Może jedynie „sklejać tekst” na podstawie wzorców.

Jeśli LLM „zaproponuje coś nowego” – to przypadek, halucynacja lub przekształcenie rzeczy już istniejących.

Hipoteza ≠ odkrycie. AI nie zrobi tego za ludzi

No więc podsumowując obecne narzędzia AI nie mogą dokonywać odkryć nie mogą prowadzić działań dowodowych, ich popularność zasadza się na LLM które są dostępne i które są szeroko wykorzystywane ale w dużej mierze przez ludzi którzy nie rozumieją na czym pracują. ChatGPT, Gemini, Claude, to wciąż tylko zbiór wag który rozumie znaczenie słów potrafi je dobierać tworząc pozory sensownej treści ale nie rozumie już takich rzeczy jak anatomia czy prawa fizyki. Dlatego AI może generować tysiące hipotez, ale żadnej z nich nie potwierdzi, nie przetestuje, nie zrozumie.

Na końcu i tak musi pojawić się człowiek, bo wszystko, czego nie możemy zrozumieć, jest bezwartościowe nawet jeśli brzmi jak przełom.

Przełomy Czy Przesądy? Świat Nauki na Krawędzi Technologicznej Iluzji

I tu właśnie dochodzimy do największego paradoksu, którego Altman zdaje się nawet nie dostrzegać:

Żeby AI mogła dokonać odkryć, musi najpierw zrozumieć świat. A żeby mogła zrozumieć świat musiałaby przestać być tym, czym jest dzisiaj: maszyną do przewidywania następnego słowa. Nie ma w tym magii, nie ma w tym „boskiej inteligencji”, nie ma w tym nawet cienia świadomości. To tylko matematyczna maszyna do kompresowania ludzkiej wiedzy i ludzkich błędów w jedną wielką statystyczną papkę.

Więc kiedy słyszę, że AI „już za chwilę” odkryje prawa natury, których nie będziemy w stanie pojąć, widzę tylko jedno:

technologię, która nauczyła się wiarygodnie brzmieć, ale nie nauczyła się rozumieć.

A cała reszta to iluzja wygodna, efektowna, dobrze sprzedająca się, ale wciąż tylko iluzja. Bo odkrycia, których nikt nie może zweryfikować, nie są żadnym przełomem. Są współczesnym odpowiednikiem wróżenia z fusów tylko że w tej wersji fusy mają miliardy parametrów i świetny PR. I dlatego warto zadać pytanie, które w Dolinie Krzemowej rzadko pada:

Czy naprawdę chcemy budować przyszłość nauki na halucynacjach, których nikt nie potrafi odróżnić od prawdy?

Bo jeśli tak, to czeka nas nie era przełomów, tylko Era Halucynacji i głupoty! Umysłowa recesja w której najważniejsze nagrody naukowe będziemy przyznawać nie za największe osiągnięcia, ale za najlepszy PR dla konkretnej halucynacji.

No responses yet